AMD consolida su estrategia en inteligencia artificial al presentar resultados récord en la prueba MLPerf Inference 5.0 y demostrar un desempeño superior con modelos avanzados como Llama 3.1 405B y DeepSeek-R1. Su plataforma Instinct, junto a su software ROCm, ofrece eficiencia, escalabilidad y menor costo frente a alternativas de la competencia.

La carrera por dominar el mercado de inteligencia artificial no da tregua, y AMD ha dado un paso firme al frente. En su participación más reciente en MLPerf Inference 5.0, la compañía presentó una serie de avances técnicos y de rendimiento que consolidan su línea de GPUs AMD Instinct como una opción altamente competitiva frente a los productos de NVIDIA.

Ronak Shah, autor del anuncio oficial, explicó que la apuesta de AMD no solo se limita a benchmarks estandarizados, sino también al soporte temprano y afinado de los modelos de IA más exigentes y utilizados en la industria, como Llama 3.1 405B de Meta, DeepSeek-R1 y Gemma 3 de Google. “Entregar valor tanto en pruebas como en entornos reales es esencial para impulsar una adopción más amplia de la IA a escala”, afirmó.

Una participación histórica en MLPerf

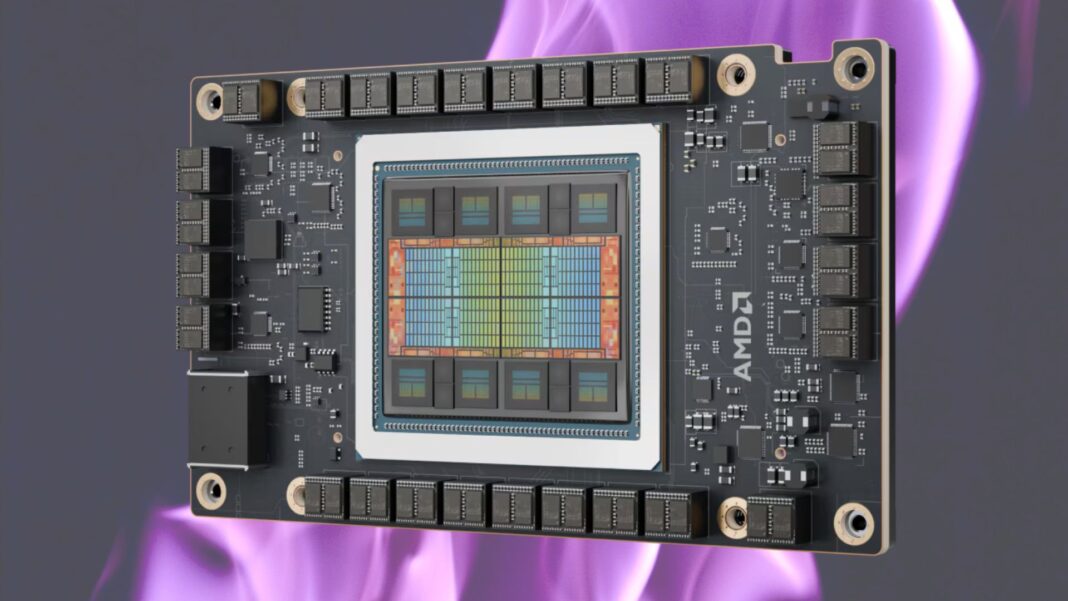

Por primera vez, AMD presentó resultados de inferencia con su más reciente GPU Instinct MI325X, lanzada en octubre de 2024. También habilitó la primera presentación multinodo junto a su socio MangoBoost y permitió que otros fabricantes, como Supermicro, ASUS y Gigabyte, entregaran resultados oficiales utilizando su hardware.

En el benchmark Llama 2 70B, todos los socios obtuvieron un rendimiento comparable al presentado por AMD, lo que evidencia la consistencia de las MI325X en entornos diversos. Además, en la tarea de generación de imágenes con Stable Diffusion XL (SDXL), AMD logró un rendimiento competitivo frente a la GPU NVIDIA H200, gracias a técnicas avanzadas de partición de GPU.

MangoBoost, por su parte, se convirtió en el primer socio en realizar una prueba multinodo con las GPUs MI300X, logrando el mayor rendimiento offline jamás registrado en MLPerf para el benchmark de Llama 2 70B.

Ventaja técnica: memoria y software optimizados

Las GPU MI325X cuentan con 2.048 TB de memoria HBM3e y un ancho de banda de 6 TB/s, permitiendo ejecutar modelos como Llama 2 70B completamente en memoria en una sola unidad, incluso incluyendo la caché de valores (KV cache). Esto evita la sobrecarga entre GPUs y maximiza el rendimiento.

Estos resultados fueron impulsados por actualizaciones clave en el ecosistema ROCm, la plataforma de software de AMD. Las últimas versiones disponibles en Infinity Hub mejoran la eficiencia de inferencia con ajustes en la planificación de kernels, optimización GEMM y manejo de memoria.

Destaca además la herramienta AMD Quark, que permite convertir precisión FP16 a FP8, y la integración de AITER (AI Tensor Engine for ROCm), un conjunto de núcleos preoptimizados que aceleran operaciones críticas como la atención múltiple y los decodificadores, con mejoras de hasta 17 veces en ejecución y más del doble en rendimiento de modelos de lenguaje grande (LLM).

Por otro lado, la nueva arquitectura abierta de rendimiento y eficiencia (OPEA) facilita la telemetría profunda para optimizar recursos en arquitecturas multinodo, tanto en la nube como en el edge.

Infraestructura lista para producción

Con estas mejoras, AMD también apunta al despliegue eficiente en entornos productivos. El operador de GPU para Kubernetes recientemente actualizado simplifica la implementación nativa, con soporte para instancias múltiples (MIG) y automatización avanzada, reduciendo los tiempos y costos operativos.

Todo esto refleja una estrategia integral: hardware potente, software abierto y herramientas pensadas para escalar la IA en cualquier entorno.

Llama 3.1 y DeepSeek-R1: modelos avanzados, resultados impresionantes

Más allá de MLPerf, AMD mostró su poderío en modelos de IA de vanguardia. El modelo DeepSeek-R1, optimizado para GPUs MI300X, multiplicó por cuatro su velocidad de inferencia en apenas dos semanas, rivalizando con los resultados del H200 de NVIDIA.

Pero uno de los hitos más relevantes es el soporte desde el primer día (Day 0) para Llama 3.1 405B, el modelo más avanzado de Meta. Gracias a su mayor ancho de banda, MI300X supera al H100 de NVIDIA en cargas de trabajo limitadas por memoria, lo que reduce la necesidad de múltiples nodos y, por tanto, los costos de infraestructura.

Por esta razón, AMD se posiciona como la solución de inferencia exclusiva para este modelo de frontera. La combinación entre rendimiento, escalabilidad y eficiencia ha sido clave para ello.

Transparencia y compromiso con el código abierto

AMD ha dejado claro que su apuesta por el software abierto y la reproducibilidad es parte esencial de su visión. Todas las pruebas presentadas pueden replicarse a través de las instrucciones publicadas en su blog oficial, y los resultados completos están disponibles en la web de MLCommons.

Este enfoque refuerza la confianza en sus soluciones, tanto para empresas que evalúan infraestructura como para desarrolladores que requieren resultados verificables.

¿Qué viene ahora?

Con las miradas puestas en la próxima ronda de MLPerf, AMD ya ha demostrado que su plataforma Instinct es más que una alternativa: es una propuesta sólida para escalar modelos de inteligencia artificial con eficiencia, rendimiento y transparencia.

Y mientras continúa optimizando su software y habilitando más modelos desde el día uno, el ecosistema ROCm y las GPUs MI300X y MI325X prometen seguir marcando el rumbo de la IA generativa y de lenguaje en 2025.

*En la creación de este texto se usaron herramientas de inteligencia artificial.